Quand l’IA sait penser mais que les humains doivent cliquer

L’IA a résolu la partie difficile et échoué sur la facile

Il y a quelques semaines, j’ai aidé une entreprise de dispositifs médicaux à utiliser l’IA pour examiner la littérature scientifique de PubMed.

Ce n’était pas une petite tâche. Des centaines d’articles devaient être analysés pour identifier uniquement ceux qui rapportaient la performance, la sécurité et les effets indésirables. Toute personne ayant déjà effectué ce type de travail sait ce que cela signifie habituellement : des jours ou des semaines de lecture attentive par des professionnels hautement qualifiés.

Avec l’IA, cela a pris quelques minutes.

Le système pouvait lire les résumés et les articles complets, comprendre le contexte médical, écarter les études non pertinentes et extraire exactement ce qui comptait. D’un point de vue cognitif, le problème était résolu. La partie la plus difficile — comprendre la science — n’était plus le goulot d’étranglement.

Et pourtant, le plus grand obstacle n’avait rien à voir avec l’IA ou la science médicale.

Ce n’est pas parce que l’IA a fait des erreurs. Ce n’est pas parce que le modèle a halluciné. Ce n’est pas parce que la logique était erronée.

Elle a échoué parce que l’IA ne pouvait pas télécharger les PDF.

CAPTCHAs, protections anti-bot, vérifications sans fin “êtes-vous humain ?” — des mécanismes conçus pour empêcher les abus, qui bloquent désormais directement le travail légitime.

L’IA pouvait évaluer des centaines d’études médicales plus rapidement que n’importe quelle équipe humaine — mais elle ne pouvait pas cocher une case.

Les logiciels anti-bot avaient du sens. Autrefois.

Les systèmes anti-bot existent pour de bonnes raisons. Ils ont été conçus pour protéger les sites web contre les abus, empêcher le scraping massif, stopper la fraude et préserver les modèles économiques basés sur la publicité ou l’accès limité.

Pendant longtemps, ils ont fonctionné selon une hypothèse simple : l’automatisation est suspecte, les humains sont légitimes.

Cette hypothèse avait du sens dans un monde où les bots se contentaient de voler du contenu, de surcharger les serveurs ou de manipuler les systèmes.

Mais ce monde a disparu.

Le web a changé notre façon de travailler — discrètement, complètement

Au cours des deux dernières décennies, nous avons déplacé presque tous les logiciels professionnels dans le navigateur.

Ce qui était autrefois des applications locales ou client-serveur est devenu des outils web, fonctionnant sur des serveurs centralisés. Systèmes CRM, ERP, logiciels de comptabilité, plateformes RH, outils marketing — tout est passé au SaaS.

Ce changement a permis une innovation incroyable. Les mises à jour sont devenues instantanées. La collaboration est devenue mondiale. Les logiciels sont devenus moins chers à distribuer et plus faciles à améliorer.

Le navigateur est devenu l’interface universelle du travail.

Et personne ne l’a remis en question.

L’IA n’a pas besoin de navigateur

L’IA remet cette hypothèse en cause.

L’IA n’a pas besoin de boutons, de menus déroulants ou de PDF. Elle ne tire aucun bénéfice des tableaux de bord ou de la pagination. Elle se moque des mises en page ou des fenêtres modales.

L’IA a besoin d’accès à l’information et d’autorisation pour agir.

Et pourtant, nous la forçons à opérer via des interfaces conçues pour les humains — fragiles, visuelles et en perpétuelle évolution.

Pour que cela fonctionne, nous avons inventé tout un écosystème d’outils.

La promesse — et la douleur — de l’automatisation web

L’automatisation du navigateur, le web scraping, la RPA, les navigateurs headless, les bots de workflow — tout un écosystème a émergé en promettant la même chose : laissez l’IA faire le travail pour vous.

En réalité, ces approches sont bien plus fragiles qu’il n’y paraît. Elles reposent sur des interfaces utilisateur qui n’ont jamais été conçues comme des points d’intégration stables, et elles se brisent de façon fréquente et imprévisible.

Un bouton bouge. Un libellé change. Un CAPTCHA apparaît. Un flux de connexion est modifié. Aucun de ces changements n’est annoncé, et aucun n’est considéré comme une rupture par l’éditeur du logiciel.

Pourtant, chacun d’eux peut silencieusement stopper l’automatisation.

Vous n’êtes jamais qu’à une petite refonte de l’interface d’une panne en production. L’automatisation qui dépend de logiciels se faisant passer pour des humains est, par définition, instable.

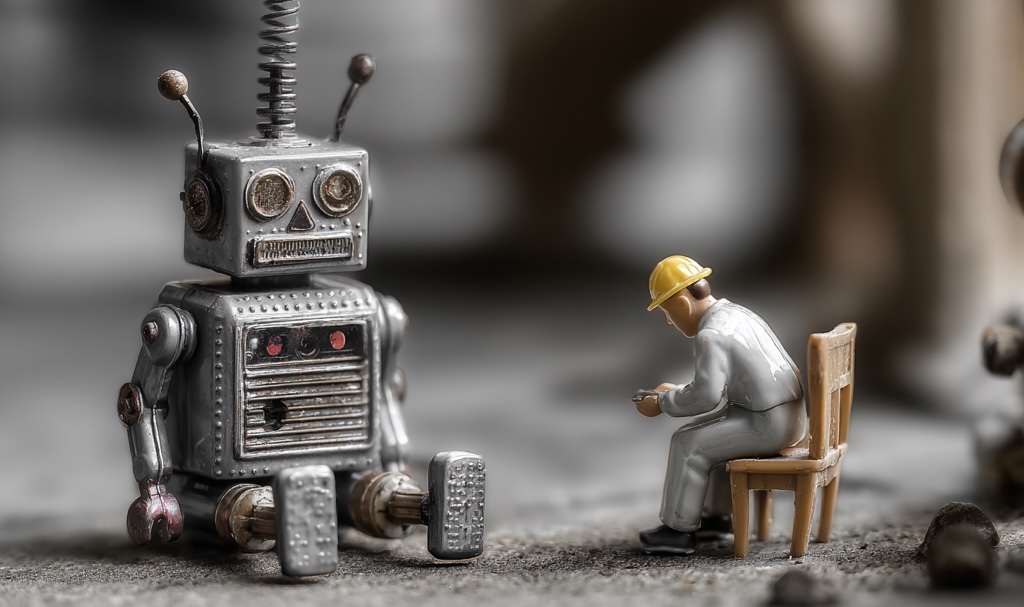

Le monde, complètement à l’envers

C’est là que les choses deviennent absurdes.

Aujourd’hui, l’IA gère les parties les plus intellectuellement exigeantes de nombreux workflows. Elle lit, raisonne, compare, résume et décide.

Pendant ce temps, les humains sont contraints d’effectuer les tâches les plus mécaniques imaginables : télécharger des PDF, cliquer sur “Je ne suis pas un robot”, résoudre des puzzles d’images, réessayer des téléchargements échoués.

Les humains sont réduits à des adaptateurs manuels entre les interfaces web et les systèmes d’IA.

Nous n’avons pas automatisé le travail. Nous avons reconfiguré la douleur.

Un business florissant fondé sur la friction

Sans surprise, il existe des entreprises spécialisées dans ce problème précis.

Des services comme 2Captcha, Anti-Captcha, DeathByCaptcha et des plateformes similaires existent pour résoudre les CAPTCHAs en les envoyant à de vrais humains, quelque part dans le monde, qui cochent les cases et résolvent les puzzles.

En d’autres termes, nous avons transformé le travail humain en une API pour que l’automatisation puisse continuer.

Plus d’IA conduit à plus de tentatives d’automatisation. Plus d’automatisation conduit à plus de mesures anti-bot. Plus de mesures anti-bot conduit à plus de travail manuel.

Ce cercle vicieux est impressionnant — et profondément défaillant.

“Anti-scraping” sans anti-pensée

Certaines entreprises ne comptent même pas sur des barrières techniques. Elles comptent sur les contrats.

De nombreux sites web incluent des clauses “anti-scraping” dans leurs conditions d’utilisation. Mais que signifie vraiment le scraping lorsqu’une IA automatise une tâche qu’un humain est explicitement autorisé à faire ?

Si je peux légalement lire un document, télécharger un PDF et l’analyser, pourquoi cela devient-il discutable lorsque le logiciel fait exactement la même chose en mon nom ?

La réponse est souvent vague. Pratique, d’ailleurs.

Nous posons la mauvaise question

Le vrai problème n’est pas l’abus. L’abus peut être géré par des limites de débit, l’authentification et la responsabilisation.

Le vrai problème, c’est que les applications posent encore la mauvaise question.

Au lieu de demander : “Êtes-vous humain ?”

Elles devraient demander : “Êtes-vous un utilisateur légitime ou une automatisation légitime ?”

Ce sont deux choses très différentes.

Si l’accès est gratuit via un navigateur, il devrait l’être via une API. Si les workflows sont autorisés pour les humains, ils devraient l’être pour une automatisation authentifiée. Les CAPTCHAs sont un outil grossier pour un monde bien plus nuancé.

Oui, la publicité complique la donne. Oui, les modèles économiques comptent. Mais forcer des professionnels hautement qualifiés à passer du temps à cliquer sur des filtres pour que l’IA puisse faire son travail n’est pas viable.

Les logiciels d’entreprise doivent évoluer — vite

À mesure que l’IA prend en charge de plus en plus de tâches cognitives, les logiciels d’entreprise font face à un choix.

Ils peuvent rester centrés sur l’interface utilisateur et forcer les humains à surveiller l’automatisation.

Ou ils peuvent devenir natifs pour l’IA et exposer les workflows, les données et les autorisations de façon à ce que les machines puissent les utiliser de manière responsable.

Les entreprises qui gagneront ne seront pas celles qui ont les plus beaux tableaux de bord.

Ce seront celles qui arrêteront de demander aux machines de faire semblant d’être humaines.

Dernière réflexion

Les systèmes anti-bot ont été conçus à l’origine pour empêcher les machines de se faire passer pour des personnes.

Quelque part en chemin, nous avons inversé cette logique. Aujourd’hui, nous payons de plus en plus des humains pour effectuer des tâches mécaniques afin que les machines puissent réfléchir.

Cette inversion devrait nous faire réfléchir.

Ce n’est probablement pas l’avenir du travail — mais c’est un signal d’alarme clair que nos architectures logicielles n’ont pas rattrapé le monde dans lequel nous vivons désormais.